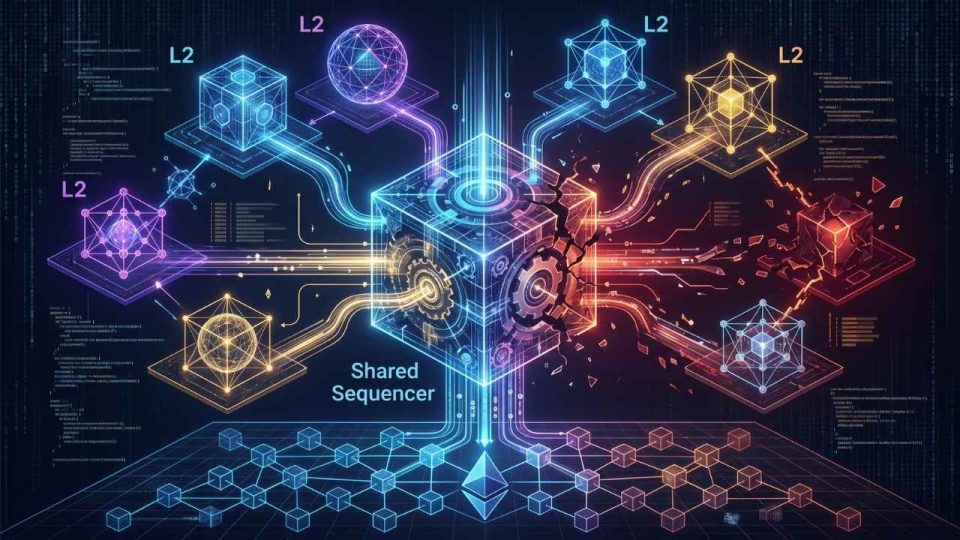

El despliegue de Shared sequencers en el ecosistema busca solucionar la fragmentación operativa que afecta a las redes actuales de Capa 2. Esta infraestructura promete coordinar el ordenamiento de transacciones entre múltiples protocolos, mejorando la interoperabilidad atómica y reduciendo el impacto del valor máximo extraíble perjudicial durante este 2026.

La adopción de estos sistemas genera una dependencia crítica en una capa externa de confianza que compromete la autonomía técnica. Es fundamental evaluar si esta solución justifica la introducción de nuevos puntos de fallo sistémico en la arquitectura modular de escalabilidad, especialmente frente a la creciente demanda de usuarios institucionales.

Un estudio técnico advierte que actualmente los rollups subvaloran transacciones pequeñas, elevando considerablemente el riesgo de denegación de servicio. Este hallazgo subraya la fragilidad de los mecanismos de ordenamiento vigentes, donde la falta de una gestión de tarifas eficiente puede paralizar la red ante ataques coordinados o picos de tráfico.

La hoja de ruta oficial de la Fundación Ethereum prioriza un enfoque centrado en rollups para unificar la liquidez sin sacrificar la seguridad básica. No obstante, al delegar el ordenamiento a terceros, se corre el riesgo de replicar los vicios de centralización presentes en la banca tradicional dentro de protocolos supuestamente descentralizados.

Históricamente, la evolución de los sistemas distribuidos demuestra que añadir intermediarios para reducir latencia suele crear vulnerabilidades críticas ocultas. En ciclos anteriores, como el de 2022, la dependencia en proveedores de servicios centralizados provocó efectos de contagio masivos que afectaron la confianza y la estabilidad de los principales activos digitales en el mercado global.

La arquitectura del consenso y sus costos económicos

Redes como Espresso utilizan protocolos de consenso avanzados para asegurar que el orden sea resistente a la censura y justo. El consenso de Espresso requiere una coordinación constante entre validadores, lo que implica que la velocidad final depende de una estabilidad de red superior a la de los propios rollups que utilizan el servicio.

Esta capa adicional no solo consume recursos computacionales importantes, sino que altera la estructura de costos de las transacciones finales. Al introducir tarifas de servicio por secuenciación compartida, los desarrolladores deben equilibrar la eficiencia operativa con la preservación de márgenes económicos para el usuario final que busca transacciones económicas y rápidas.

La visibilidad privilegiada que obtienen los operadores permite capturar beneficios económicos mediante el ordenamiento opaco de flujos financieros. Según los datos de Flashbots, la extracción de valor mediante arbitraje sigue siendo una fuerza dominante que influye en el diseño de protocolos. Trasladar esta dinámica desplaza el problema hacia entornos menos supervisados por la comunidad del protocolo.

La implementación de pruebas de fraude para un secuenciador compartido es técnicamente más compleja que para un operador único centralizado. Esta dificultad técnica eleva el riesgo operativo, ya que detectar irregularidades requiere mecanismos de verificación cruzada entre múltiples capas de ejecución que actualmente se encuentran en una fase de desarrollo experimental y temprano.

El dilema de la interoperabilidad frente a la autonomía

Quienes defienden la secuenciación compartida sostienen que es la vía principal para evitar que el capital quede atrapado en silos tecnológicos aislados. La capacidad de ejecutar swaps entre capas en un solo bloque reduciría drásticamente el deslizamiento de precios para instituciones que operan con grandes volúmenes de liquidez en el ecosistema.

Por otro lado, los rollups basados intentan resolver este conflicto integrándose directamente en el conjunto de validadores de la red principal. Esta aproximación busca unificar el ecosistema sin introducir entidades externas que posean su propia economía de tokens o reglas de gobernanza independientes que puedan entrar en conflicto con la red Ethereum.

La soberanía de una blockchain reside en la capacidad de dictar sus propias reglas de inclusión sin interferencias externas. Si un secuenciador compartido decide censurar direcciones por presiones legales, todos los protocolos conectados perderán su neutralidad de manera simultánea y coordinada, generando un riesgo sistémico inaceptable para los desarrolladores de aplicaciones globales.

Los actores institucionales requieren marcos de cumplimiento claros y garantías de ejecución que no dependan de intermediarios desconocidos. La arquitectura modular introduce capas de abstracción que pueden dificultar la auditoría de riesgos de contraparte en transacciones complejas que atraviesan múltiples redes de segunda capa de forma sincronizada y automática.

Al igual que ocurrió con los proveedores de servicios en la nube, la concentración de infraestructura genera puntos únicos de fallo. Si un proveedor dominante de secuenciación experimenta una interrupción, el ecosistema de rollups podría sufrir una parálisis operativa total afectando a millones de usuarios que dependen de la finalidad rápida de sus transacciones digitales.

El equilibrio entre eficiencia y descentralización es el desafío técnico más complejo del presente ciclo de desarrollo tecnológico. Aunque los secuenciadores compartidos ofrecen mejoras en latencia, no deben convertirse en una capa de peaje que capture el valor generado por la innovación en las capas superiores de la red sin ofrecer garantías de seguridad.

Si la adopción de redes de secuenciación compartida supera el 40% del valor total bloqueado sin descentralización, la vulnerabilidad sistémica ante errores de liveness será inevitable. La resiliencia del ecosistema dependerá de que la coordinación cross-chain no sacrifique la autonomía técnica fundamental de cada protocolo individual frente a fallos externos críticos.

Este artículo es informativo y no constituye asesoramiento financiero.